Het is alweer 2026 en onze smartphones zijn inmiddels zo slim dat de verleiding groot is om blind te vertrouwen op de AI-rekenkracht in je telefoon. iPhones en Samsungs denken ongevraagd mee met elke foto die je maakt en elk jaar draaien ze er een AI-tandje bij. Maar nu is er een tegengeluid: Adobe Labs kiest met Project Indigo voor een andere route. Het is een app die de regie weer terugbrengt bij degene die de camera vasthoudt. Is dat handig? Ja en nee, maar het is in ieder geval goed om je ervan bewust te zijn wat die algoritmes in je smartphone allemaal uitspoken.

Want denk jij nog dat de foto’s die uit je smartphone rollen ’onbewerkt’ zijn? Nou, vergeet het maar. Als je een foto schiet, voert je smartphone bizar veel berekeningen uit om een zo acceptabel mogelijke afbeelding te produceren. Een deel van dat proces zie je al als je je smartphonecamera bijvoorbeeld op een stuk blauwe lucht richt. Vergelijk die lucht op je scherm eens met de werkelijkheid. Wat zie je dan? De kans is groot dat het blauw op je scherm een flink stuk blauwer oogt. Best mooi misschien, maar vaak ook best overdreven.

En daar blijft het niet bij. De software in je telefoon maakt wolken witter, schaduwen lichter, details scherper, kleuren intenser, contrast hoger en nog veel meer. Zodra je op de ontspanknop drukt, gaat er een leger aan algoritmes aan de slag. Die analyseren razendsnel het beeld dat je wilt vastleggen, en de camera schiet meerdere foto’s na elkaar met verschillende belichtingstijden. Je telefoon combineert ze daarna belachelijk snel tot één foto.

En jij denkt dan dat je één ‘onbewerkte’ foto hebt geschoten 😉

Die technologie achter die software heet computational photography en dat zou je kunnen uitleggen als ‘slimme beeldverwerking via software tijdens het maken van een foto’. Is dat handig? Nou en of! Je kunt met weinig kennis van fotografie mooie, acceptabele foto’s schieten. En daarnaast kun je je helemaal richten op het beeld dat je wil creëren in plaats van dat je je druk moet maken over belichtingstijden en grote licht/donkerverschillen in je foto.

Maar waar komt die slimme techniek eigenlijk vandaan? En waarom is het op smartphones zó alom aanwezig?

Kleine sensors, slimme snufjes

Computational photography is een term uit de jaren 90, maar er is één man die het introduceerde in de wereld van smartphonecamera’s. Marc Levoy leidde bij Google jarenlang de teams die verantwoordelijk waren voor de Pixel-camera’s. Onder zijn leiding werden slimme technische snufjes als HDR+, portretmodus en nachtmodus ontwikkeld als compensatie voor de kleine camerasensors in smartphones. Want er was (en er is) simpelweg geen ruimte voor een uit de kluiten gewassen sensor, maar er is wel een flinke berg rekenkracht beschikbaar.

Die Levoy zou je kunnen zien als het meesterbrein achter computational photography op smartphones. Fabrikanten als Apple en Samsung bouwden daar verder op voort en dat doen ze nog steeds.

Maar die ultraslimme beeldbewerkingstechnologie kent ook nadelen. De te blauwe lucht heb ik al genoemd, maar er zijn meer pijnpunten. De standaard camera-software van telefoonfabrikanten heeft de neiging om foto’s naar een gemiddelde waarde te trekken. Diepe, zwarte schaduwen zijn ‘ongewenst’ en worden flink opgelicht, op zonnige dagen worden kleuren te ver opgepompt, en de verscherping kan soms zo agressief uitpakken dat je lichte randjes rondom objecten gaat zien.

Moon Gate

Niemand klaagt over dit soort aanpassingen, tenzij het al te nep wordt. Misschien heb je ooit gehoord over de ophef die bekend werd als ‘Moon Gate’. In 2023 bleek dat Samsung-smartphones AI gebruiken om maanfoto’s kunstmatig te ‘verbeteren’. De software herkent de maan en plakt er die typische maanstructuur en details overheen die de camerasensor zelf never nooit scherp had kunnen krijgen, waardoor de foto eigenlijk deels door AI is ingevuld. Volgens Samsung is dat gewoon een onderdeel van de ‘slimme beeldoptimalisatie’ in hun smartphones.

Toch beginnen die maanfoto’s wat op een virus te lijken. Op Facebook worden nog steeds foto’s gepost van wat ik ‘Samsung-manen’ noem. De maan vol in beeld, nul compositie of visie, en de trots ‘dat het gelukt is’ om de maan vast te leggen. Dat is pronken met de veren van AI in een smartphone.

Dat AI wordt ingezet om je foto’s beter te maken, is op zich prima, maar het is wel handig als je weet met welke middelen dat beeld tot stand komt. Daarbij is het ook wel zo leuk en creatief dat je er nog iets van jezelf inlegt in plaats van een droge registratie van een hemellichaam.

De weg terug

Maar nu komt het: Marc Levoy stapte in 2020 over van Google naar Adobe, je weet wel, de makers van Photoshop en Lightroom. Daar startte hij een onderzoeksproject van Adobe Labs dat inmiddels als gratis bèta-app voor de iPhone beschikbaar is: Project Indigo. Maar waar hij bij Google nog probeerde om de perfecte foto voor de massa te maken, lijkt hij bij Adobe een andere missie te hebben: de software moet ‘effe dimmen’ en de controle teruggeven aan de fotograaf. Het doel van Project Indigo is namelijk om smartphone-fotografie te ontdoen van dat typische, net-wat-overbewerkte computational photography-sausje.

Wat Indigo anders doet

Project Indigo gooit het dus over een andere boeg dan je standaard camera-app. Indigo schiet bij een druk op de ontspanknop een flinke reeks foto’s (tot wel 32 beelden) en voegt die samen. Ter vergelijking: Apple en Samsung schijnen 4 tot 12 beelden te stapelen voor één foto.

Het doel van dat ‘beeldjes stapelen’ is dit keer niet om de kleuren te laten knallen en schaduwen op te lichten, maar om ruis te verminderen en een groot dynamisch bereik te creëren zonder dat het onnatuurlijk oogt. De camera-app houdt zich ook verre van digitale verscherping. Het doel is een foto die wat kleur, licht en contrast betreft, meer de werkelijkheid benadert.

Links de foto die de standaard iPhone camera-app maakt, rechts het ruwe beeld dat uit Project Indigo komt en dus nog bewerkt moet worden.

Ik zeg bewust ‘doel’, want het is even schrikken en slikken als je je eerste foto‘s ziet die Project Indigo aflevert. De camera levert kale (RAW-)foto’s af die er wat vlak en kleurloos uitzien, maar dat is precies wat de makers voor ogen hebben. Indigo levert de basis, een halffabrikaat zou je kunnen zeggen. Jíj bepaalt waar het contrast komt. Jíj bepaalt de sfeer. De app is voor smartphone-fotografen die weer zelf de volledige regie over hun foto willen hebben in plaats van dat een algoritme uit Cupertino of Zuid-Korea dat voor ze beslist.

De RAW-afbeelding die uit Indigo rolt, kun je met een doorlusknopje meteen bewerken in Lightroom mobile. Jaha, zo slim zijn ze dan natuurlijk wel bij Adobe.

Het verschil in sfeer komt vooral tot uiting in avondopnamen. In de foto’s hieronder zie je dat de iPhone-camera de donkere nacht wil oplichten tot bijna-daglicht. Knap, maar ook onnodig. Project Indigo houdt zich meer aan de werkelijkheid.

Is het ook werkbaar?

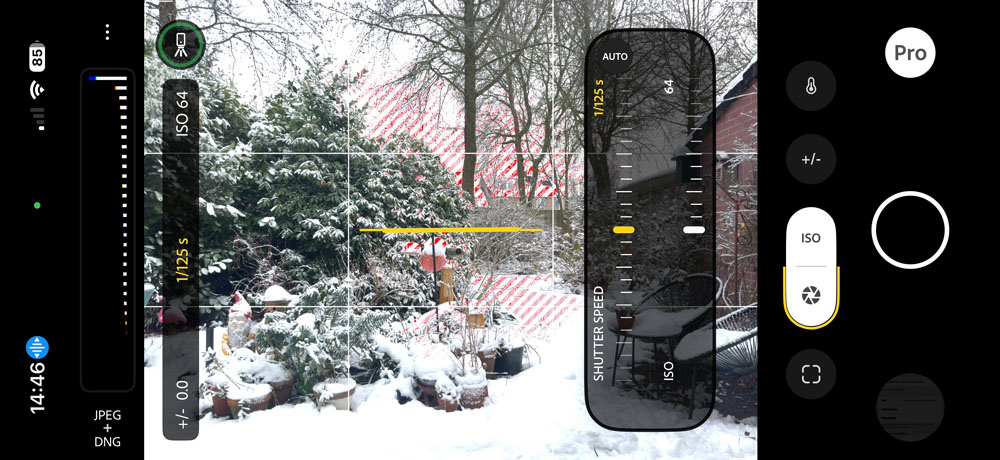

Project Indigo is nog niet rijp voor een echte review, dus dat doe ik dan ook niet. Als je zo dapper bent om de app uit te proberen, kan ik je aanraden om de Pro-stand te activeren want die werkt verrassend goed. Veel externe camera-apps proberen foolproof te zijn in de bediening van sluitertijd, ISO en afstand, maar dat lukt lang niet altijd.

In de Pro-stand van Indigo kun je bijvoorbeeld heel duidelijk aangeven dat je de ISO zo laag mogelijk wilt vastzetten en dat de sluitertijd zich daar automatisch op moet aanpassen. Of juist andersom. Ook handig is dat je bij het handmatig scherpstellen een vergrootglas kunt activeren om te kijken of een deel van je foto écht scherp is.

Weet wel dat Indigo op dit moment nog een experiment is van Adobe Labs en alleen op een iPhone draait. De maximale resolutie blijft hangen op 12 megapixel, waarschijnlijk om de bestandsomvang te beperken. Je iPhone wordt na een tijdje fotograferen aardig warm (wel handig in de winter) en de batterij loopt sneller leeg dan een fles wijn op zondagmiddag. Al moet ik zeggen dat de app op mijn iPhone 17 Pro een stuk beter en sneller functioneert dan eerder op de 15 Pro. Adobe geeft aan dat de app flink wat rekenkracht nodig heeft. Je hebt minimaal een iPhone 12 Pro nodig.

Of we over twee jaar allemaal met Indigo fotograferen? Ik denk het niet. Maar het feit dat de man achter de Pixel-camera nu min of meer toegeeft dat smartphonefoto’s te veel cosmetische chirurgie meekrijgen, vond ik op zijn minst interessant. Ik ben benieuwd hoe jij, aardige lezer, daarover denkt. Laat het vooral weten in de reacties onder deze blog.

En (Pro)RAW en Expert RAW dan?

Dat is een goede vraag van je! Het antwoord is dat RAW computational photography niet volledig omzeilt. Zowel bij Apple als Samsung (ook in de Pro-stand) schiet de smartphone meerdere beelden en gaan algoritmes aan het werk met HDR, ruisreductie, lenscorrecties, witbalans, kleur, tooncurve en contrast. Het resultaat is een DNG (digitaal negatief) met meer speelruimte dan een JPG- of HEIC-bestand, maar minder dan een ‘echt’ RAW-bestand zoals er uit Project Indigo rolt.

Gerard,

de foto met de gegevens welke app gebruik je daarvoor. Met name gaat het mij waar je het hebt over het vergrootglas.

Zelf heb ik de Nokia G50, maar die corrigeert weinig wat ik fotografeer. Niet een extra blauwe lucht. De google camera was ik kwijt maar toch weer teruggevonden en heb destijds op jouw advies, hier in je rubriek de Pro Shot camera app geïnstalleerd. Die bevalt goed, alleen jammer dat als je inzoomen wil, niet altijd echt fijn gaat, te abrupt vergroot. Ik ga zelf nooit verder dan stand 2.

Niet ook dat ik alles begrijp van de instellingen.

Hartelijke groet Gerrit.

Dat is de Project Indigo-app! Tot nu toe alleen beschikbaar voor iPhones helaas.